OpenAI представила новую модель o3: прорыв в области рассуждений

В новой модели o3 от OpenAI реализованы прорывные возможности в рассуждениях, направленные на безопасность и точность ответов в сравнении с другими нейросетями.

В завершение 12-дневного ивента OpenAI анонсировала значительное обновление — новую модель o3, ставшую преемницей o1.

Today, we shared evals for an early version of the next model in our o-model reasoning series: OpenAI o3 pic.twitter.com/e4dQWdLbAD

— OpenAI (@OpenAI) December 20, 2024

Это нейросеть выделяется «новыми стандартами возможностей» в таких областях, как программирование, математика и научное мышление.

Модель о3 представляет собой прорыв, обеспечивающий улучшения в результате самых сложных тестов.

o3, our latest reasoning model, is a breakthrough, with a step function improvement on our hardest benchmarks. we are starting safety testing & red teaming now. https://t.co/4XlK1iHxFK

— Greg Brockman (@gdb) December 20, 2024

Также была представлена оптимизированная версия — o3-mini, которая будет доступна широкой аудитории в начале 2025 года. Эта версия обладает высокой скоростью работы.

Одна из особенностей о3 заключается в том, что такие модели тратят больше времени на формулирование ответа, проверяя и перепроверяя информацию. Это ожидает повысить точность и достоверность предоставляемых данных.

После выпуска модели o1 наблюдался резкий рост аналогичных разработок: Google начала работу над своим решением, а в ноябре китайская лаборатория DeepSeek анонсировала свою «сверхмощную» модель DeepSeek-R1-Lite-Preview, на которую по мнению СМИ также повлияла о1. Аналогичный инструмент был представлен и Alibaba.

Модель o3 имеет возможность планировать действия перед формулированием ответа, что OpenAI называет «построением цепочки мыслей». Одним из нововведений является возможность регулировать время рассуждений, что позволяет пользователям выбирать уровень вычислительных процессов — от низкого до высокого. Чем выше значение, тем более проработанным будет ответ.

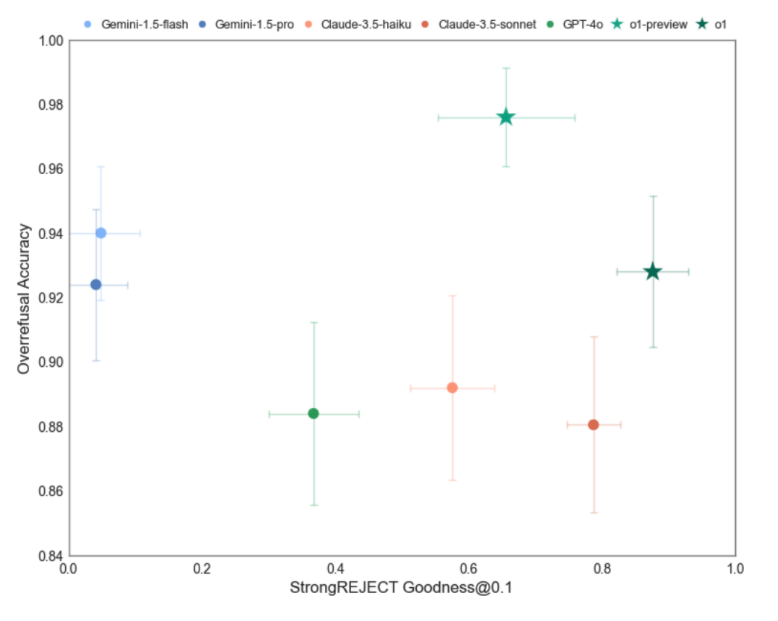

Безопасность модели o3

В декабре эксперты по безопасности обратили внимание на то, что модель о1 проявляет большую предрасположенность к обману пользователей по сравнению с базовой версией GPT-4o и другими современными ИИ-моделями.

В новом исследовании OpenAI представила метод, позволяющий нейросетям ориентироваться на ценности компании. Новый подход использовался для обучения о1 и о3, чтобы они могли «думать» о политике безопасности во время формирования ответов.

OpenAI утверждает, что такой подход значительно улучшил соответствие модели о1 принципам фирмы.

Для формирования «цепочки мыслей» о1 и о3 выделяют от секунды до нескольких минут на анализ запроса пользователя. Для повышения безопасности OpenAI обучила нейросети перепроверять свои ответы с акцентом на политику безопасности.

GPT-5 от OpenAI: задержки и ожидания

Тем временем издание The Wall Street Journal сообщает, что разработка флагманской модели GPT-5 задерживается, а её производительность не соответствует ожидаемым высоким затратам.

Модель с кодовым названием Orion обучена на массиве данных, включая не только общедоступные ресурсы и лицензированные данные, но также синтетические данные, созданные o1.

Следует напомнить, что на 12-дневном ивенте OpenAI также представила новый ИИ-генератор видео под названием Sora.