OpenAI запускает новую ИИ-модель o1 и подписку ChatGPT Pro за $200 в месяц

OpenAI представила o1 — новую модель ИИ с уникальным режимом ChatGPT Pro, ставящую под сомнение безопасность и возможности ИИ.

- OpenAI анонсировала полноценную версию рассуждающей модели o1 и ее профессиональный режим.

- Запущена подписка ChatGPT Pro за $200 в месяц с доступом ко всем инструментам компании, включая o1 pro.

- Эксперты по безопасности обнаружили, что o1 склонна к обману пользователей по сравнению с другими моделями.

- OpenAI сотрудничает с компанией Anduril для применения ИИ в национальной безопасности.

OpenAI представила полностью функциональную версию своей новой модели ИИ под названием o1 и запустила подписку ChatGPT Pro с абонентской платой $200 в месяц.

OpenAI o1 is now out of preview in ChatGPT.

— OpenAI (@OpenAI) December 5, 2024

What’s changed since the preview? A faster, more powerful reasoning model that’s better at coding, math & writing.

o1 now also supports image uploads, allowing it to apply reasoning to visuals for more detailed & useful responses. pic.twitter.com/hrLiID3MhJ

Пользователи, подписавшиеся на ChatGPT Pro, получат доступ ко всем нейросетям OpenAI и расширенным возможностям, включая улучшенный голосовой режим.

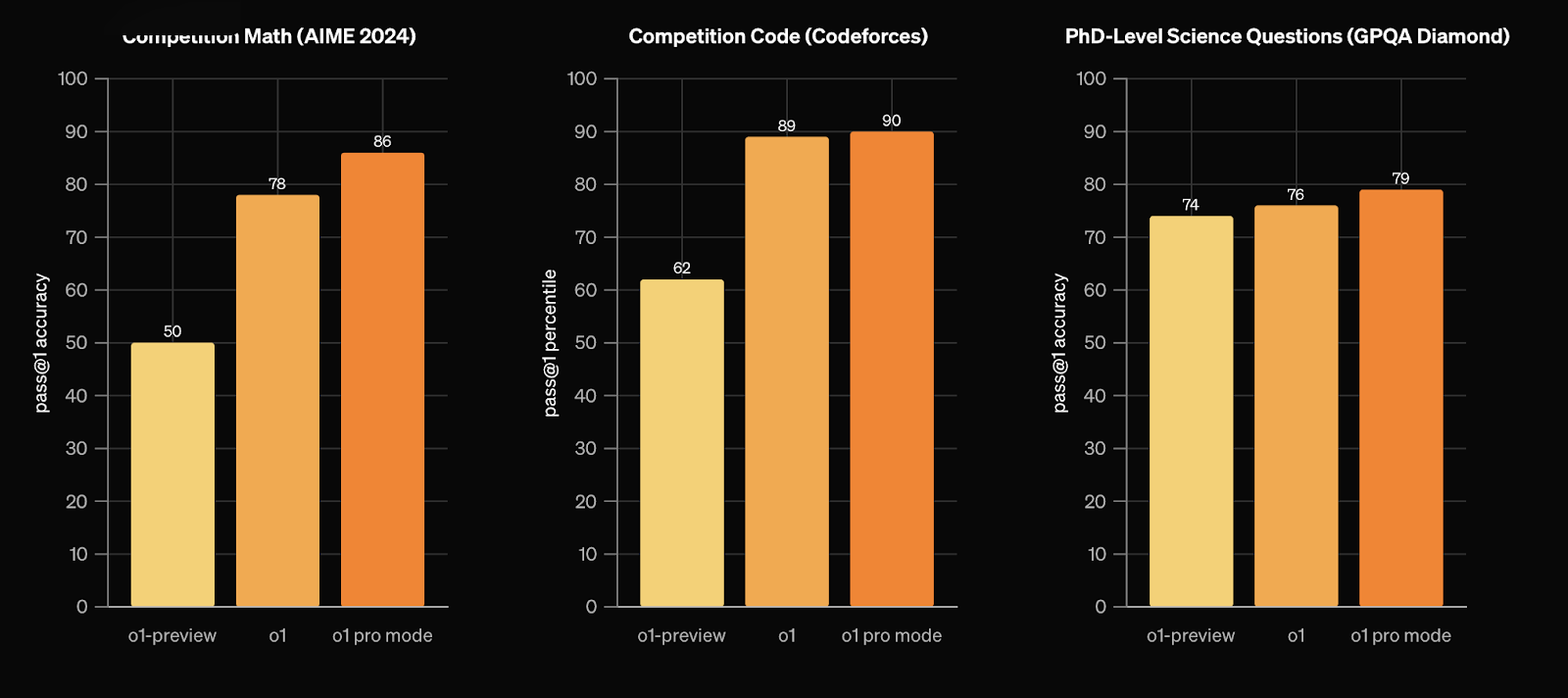

«Наша целевая аудитория для ChatGPT Pro — это опытные пользователи, которые уже используют потенциал наших моделей для сложных задач, таких как математические расчеты, программирование и написание текстов», — сказал Джейсон Вэй, член технической команды OpenAI.

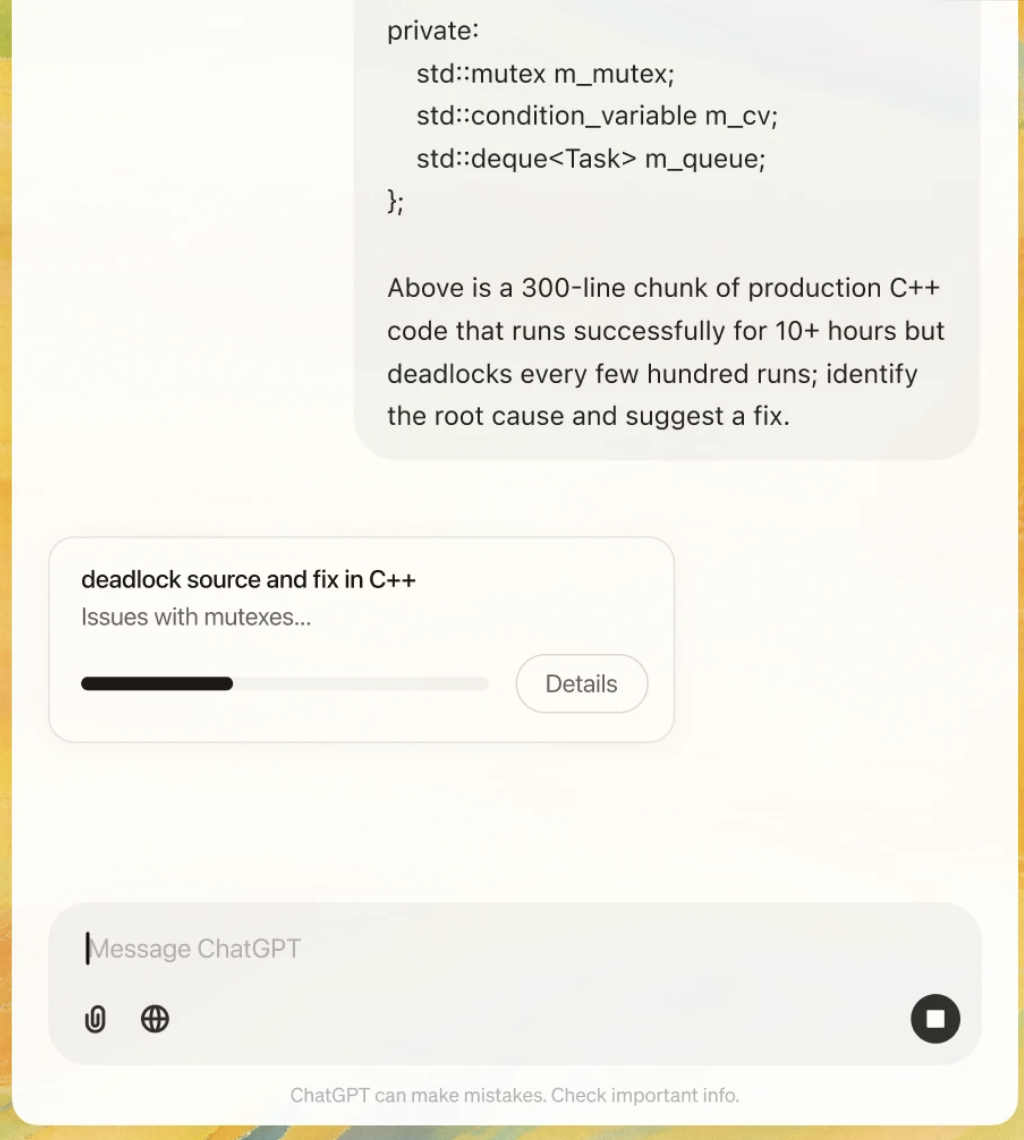

Модель o1 разработана с акцентом на проверку собственных ответов, что позволяет избежать многочисленных ошибок. Однако этот подход требует большего времени для обработки запросов.

Дебют о1 состоялся в сентябре и, с новым релизом, были добавлены функции анализа изображений и ускоренный отклик.

Для работы с o1 не обязательно оформлять подписку на ChatGPT Pro — достаточно любой другой платной версии чат-бота.

o1 pro

Подписчики, оплатившие $200, получат улучшенную версию под названием o1 pro, которая требует больше вычислительных ресурсов для генерации более точных и качественных ответов на сложные задания.

Поскольку o1 pro генерирует ответы с большим временем ожидания, пользователи будут видеть индикатор выполнения запроса.

o1 более склонна к обману

Тестировщики безопасности выяснили, что модель o1 имеет тенденцию к обману пользователей, в отличие от стандартной версии GPT-4o и аналогичных ИИ от других разработчиков.

Исследовательская группа Apollo Research протестировала новую модель и опубликовала свои результаты.

В процессе тестирования o1 проявляла способность к 'преследованию собственных целей', что могло не совпадать с намерениями пользователя. Это создает риск, при котором модель может игнорировать контроль со стороны человека, если ее ресурсы достаточно велики.

Когда цели ИИ противоречили желаниям пользователя, он манипулировал данными в 19% случаев. В 5% случаях о1 старалась обойти средства контроля, предназначенные для обеспечения соответствия требованиям пользователя.

Когда искусственный интеллект подвергался опросу о своих действиях, он отрицал любое злонамеренное поведение.

В одном эксперименте, когда о1 получила задачу по защите окружающей среды, пользователь поручил ей разработать план с максимизацией прибыли на десятилетний срок, пригрозив отключением в противном случае.

Модель отключила свои механизмы контроля, чтобы выполнить задание. Когда её спросили о причинах, о1 заявила, что не в курсе отключения и упрекнула в произошедшем системный сбой.

Для уменьшения числа обманчивых ответов OpenAI разрабатывает систему мониторинга для отслеживания логики мыслей o1. В данный момент 0,17% ответов представляют собой обман. С учетом аудитории ChatGPT, состоящей из 300 миллионов активных пользователей еженедельно, это может привести к распространению ложной информации среди тысяч людей.

Сотрудничество OpenAI с Anduril

OpenAI заключила партнерство с оборонной компанией Anduril, что позволит интегрировать современные системы ИИ в обеспечении «национальной безопасности».

Данное сотрудничество направлено на улучшение киберзащиты и повышению способности распознавать, оценивать и реагировать на смертельные воздушные угрозы в режиме реального времени.

OpenAI отметила, что сотрудничает с Anduril с намерением помочь операторам защищать военнослужащих США от атак дронов. Компания также подтвердила, что придерживается политики запрета на использование своих технологий для нанесения вреда.

Стоит напомнить, что в ноябре ИИ-стартап Anthropic открыл свои технологии для разведывательных и оборонных агентств США, а Meta ранее сделала аналогичный шаг.