Как Яндекс помогает запускать большие языковые модели на обычных устройствах

Яндекс представил сервис для запуска языковых моделей на обычных устройствах, снижая вычислительные расходы и обеспечивая доступ к мощным инструментам для разработчиков и исследователей.

Сегодня, 9 декабря, пресс-служба компании Яндекс сообщила, что Владимир Малиновский, исследователь из научного отдела Yandex Research, сумел создать уникальный сервис, позволяющий запускать большие языковые модели с 8 миллиардами параметров на компьютере, ноутбуке или даже смартфоне. Для этого используется интерфейс браузера (любого, не только фирменного от Яндекса) и, по словам автора проекта, новый сервис предоставит возможность корпорациям, стартапам и исследователям существенно сократить свои расходы на необходимые для работы LLM вычислительные мощности. Кроме того, свои труды автор опубликовал в открытом доступе на GitHub — пользоваться может любой желающий.

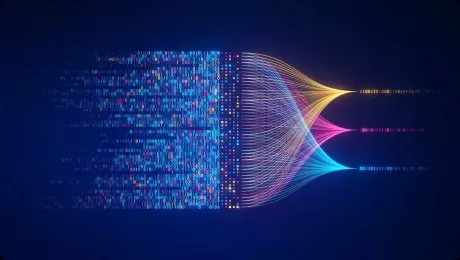

Российский разработчик объяснил, что ему удалось перенести все необходимые вычислительные процессы непосредственно на устройство, а также полностью нивелировать необходимость задействовать крайне дорогое аппаратное обеспечение вроде графических ускорителей, благодаря технологии сжатия нейросетей под названием AQLM. Эту систему команда специалистов из Yandex Research совместно с университетами ISTA и KAUST разработала летом 2024 года, а теперь посредством комбинации методов AQLM и PV-tuning разработчику удалось «уменьшить» нейросеть, позволив запускать её практически на любом современном устройстве.

Суть в том, что за счёт AQLM господин Малиновский сумел сжать размер большой языковой модели до восьми раз, попутно ускорив её, а метод PV-tuning исправил различного рода ошибки, которые обычно возникают в процессе сжатия нейросети. В результате специалисту удалось существенно уменьшить вес языковой модели Llama3.1-8B, сохранив при этом примерно 80% от изначального качества ответов.

«Программа написана на языке программирования Rust с помощью технологии WebAssembly, позволяющей запускать проект на любом языке внутри браузера».

Изучить возможности новой системы можно уже сейчас — при запуске платформы на устройство пользователя из облака будет загружена большая языковая модель Llama3.1-8B, сжатая в шесть раз (конечный вес нейросети около 2,5 ГБ). И после того, как LLM будет установлена, работать с нейросетью можно даже без подключения к интернету, но скорость ответов, по информации Яндекса, напрямую зависит от производительности конкретного устройства. К примеру, на ноутбуке MacBook Pro с процессором M1 скорость достигает 1,5 токена (3-4 символа) в секунду.